·Pesquisa Aplicada

·Pesquisa AplicadaDesign que ativa

o cérebro.

Como medimos, com inteligência artificial da Meta, o efeito neural da experiência multimodal nos nossos ambientes decorados digitalmente.

Maio · 2026

10 vereditos validados

Por que algumas experiências decorativas marcam mais que outras?

Arquitetos e designers sempre suspeitaram da resposta. Em 2026, a neurociência computacional permitiu, pela primeira vez, testá-la diretamente.

TRIBE V2

Modelo preditivo de respostas cerebrais a estímulos multimodais — vídeo, áudio e texto — desenvolvido pela Meta AI e treinado em milhares de horas de fMRI humano.

Dado um estímulo audiovisual, o modelo gera o mapa cortical previsto: onde o cérebro humano ativaria ao receber aquele estímulo.

“Predicting brain responses to multimodal stimuli, second by second.”Meta AI · TRIBE V2 · fev. 2026

Dois estímulos. Dez ambientes.

Mesmo cérebro previsto.

Ambiente original

Vídeo cinematográfico do espaço antes da decoração digital. Sem áudio. Sem narração. Sem texto.

Experiência integrada

Vídeo cinematográfico do decorado digital com áudio diegético, narração curatorial e legendas tipográficas sincronizadas.

Cada par foi processado pelo TRIBE V2. Comparamos os mapas corticais.

Se a experiência integrada faz diferença, deve recrutar redes auditivas e linguísticas que a versão silente não recruta.

Pré-registramos a hipótese antes de gerar os heatmaps — para evitar interpretar os dados retroativamente. Era passar ou falhar.

Cinco camadas de experiência.

do Arquiteto de Bolso

22 segundos · 1080p

coerente com a cena

descrevendo materiais

sincronizados à fala

Cada elemento gerado por IA do Google Cloud (Veo, Gemini, Cloud TTS), orquestrados em pipeline local.

Três neurocientistas. Três papéis. Um veredito.

Cada par de heatmaps passa por uma avaliação inspirada na revisão por pares acadêmica — três personas com perspectivas estruturalmente opostas, instanciadas em prompts independentes.

Argumenta a favor da experiência integrada. Articula evidências de recrutamento adicional em redes corticais auditivas, linguísticas e de integração multimodal.

Identifica confounds, limitações estatísticas e interpretações alternativas. Propõe controles experimentais que fortaleceriam a tese.

Examina os heatmaps antes de ler defesa e refutação. Pondera os argumentos. Emite um dos quatro veredictos: A — Validado, B — Parcialmente, C — Insuficiente, D — Refutado.

As três personas são instanciadas em prompts independentes, sem visibilidade entre elas durante a análise — garantindo independência argumentativa antes do veredito.

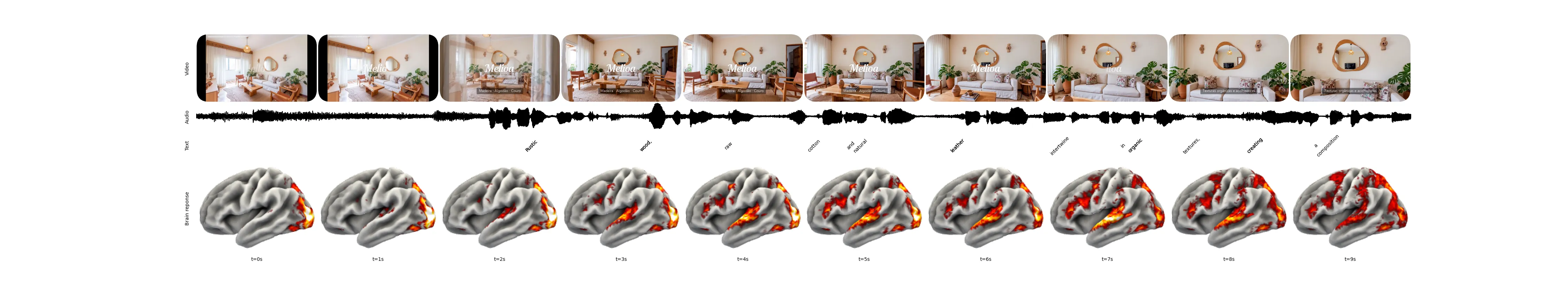

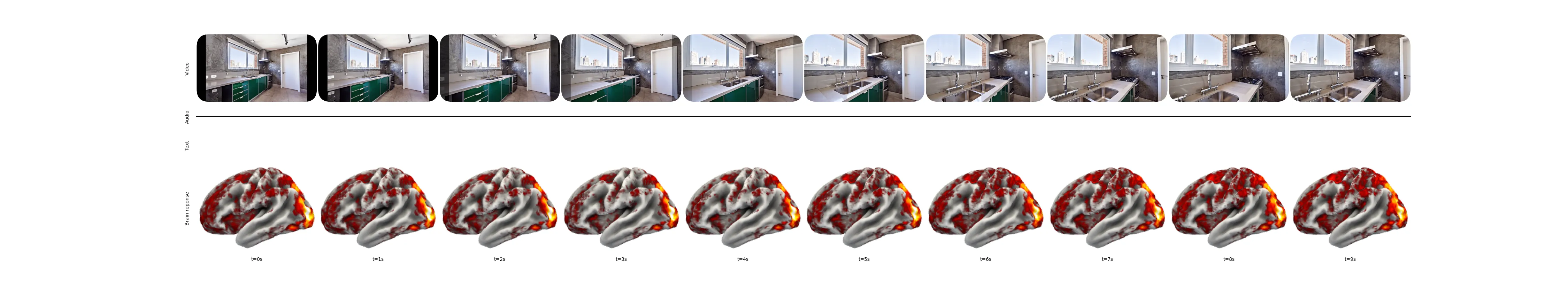

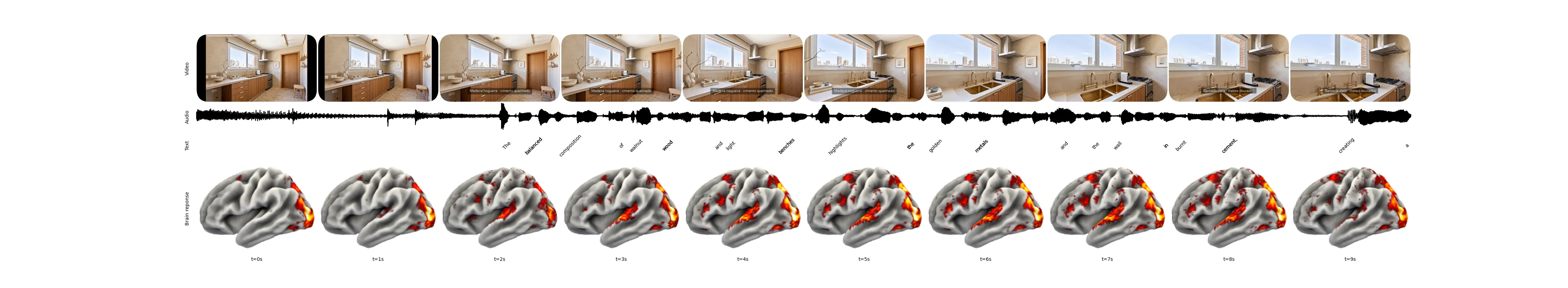

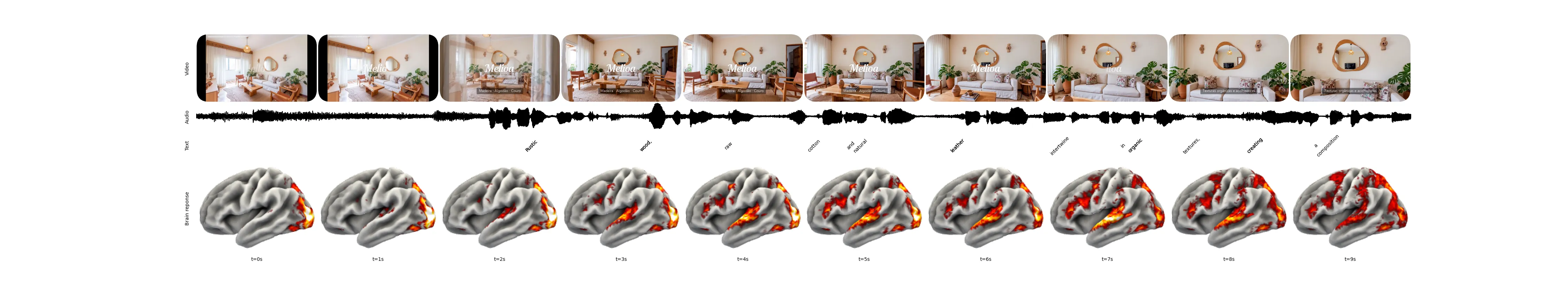

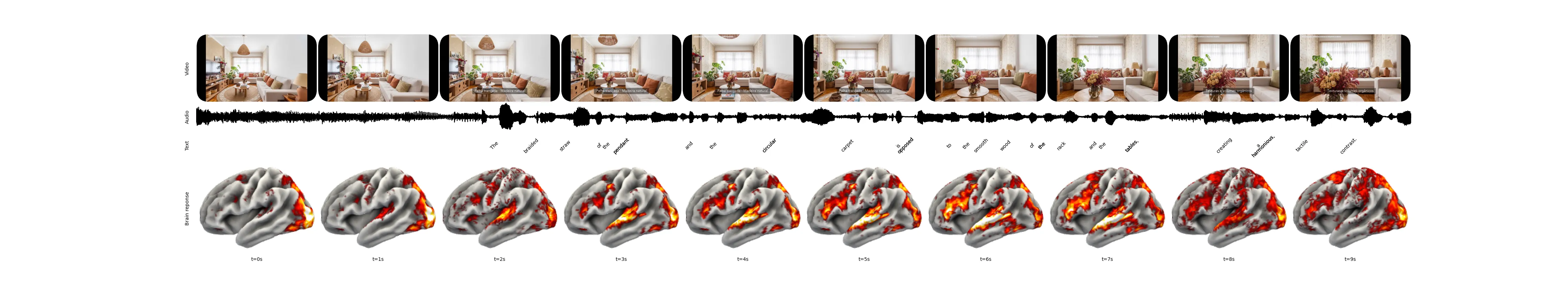

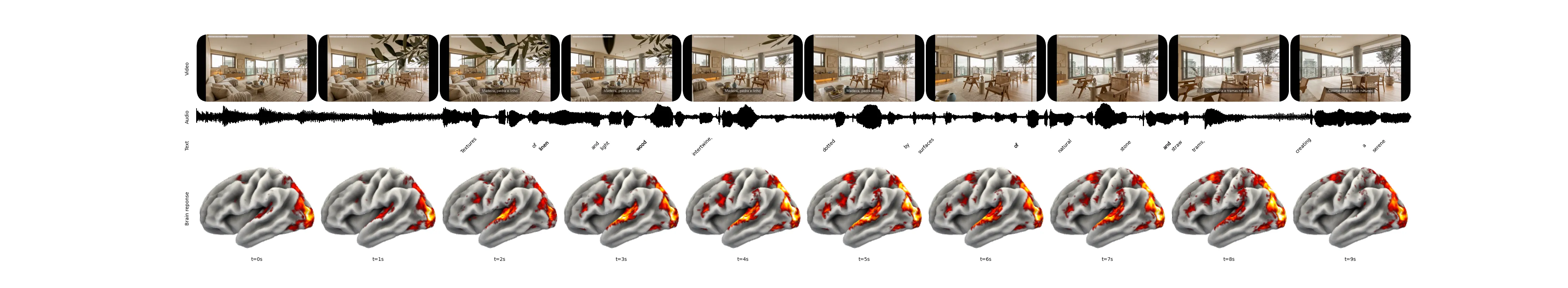

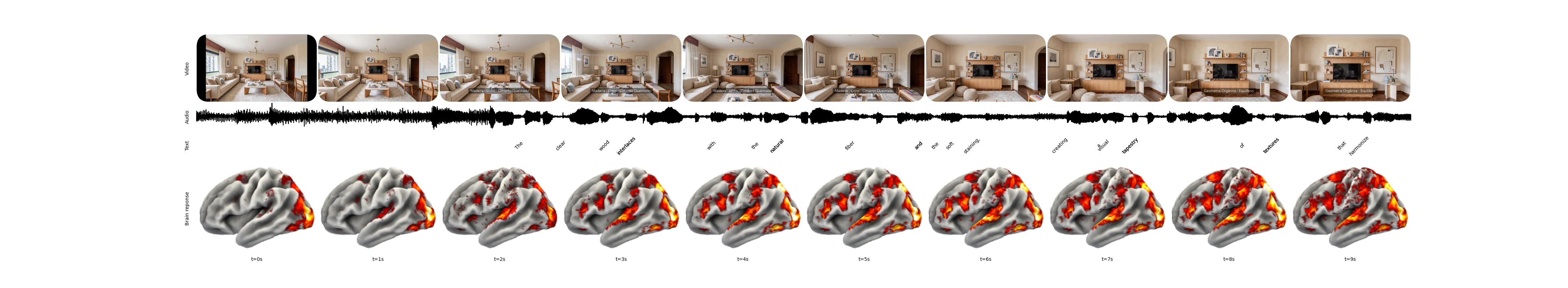

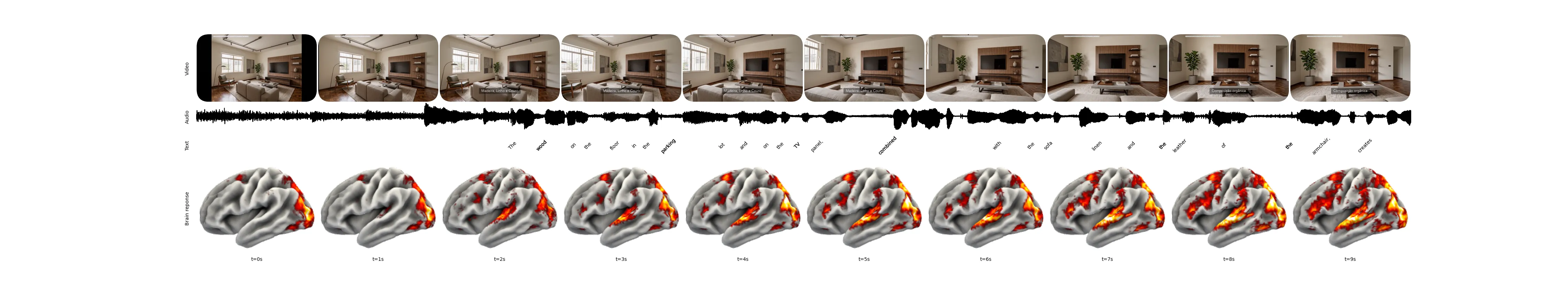

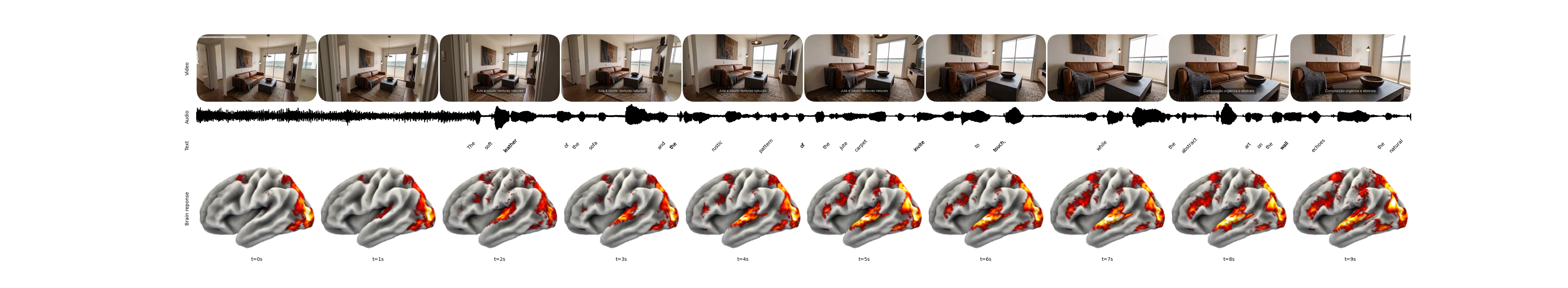

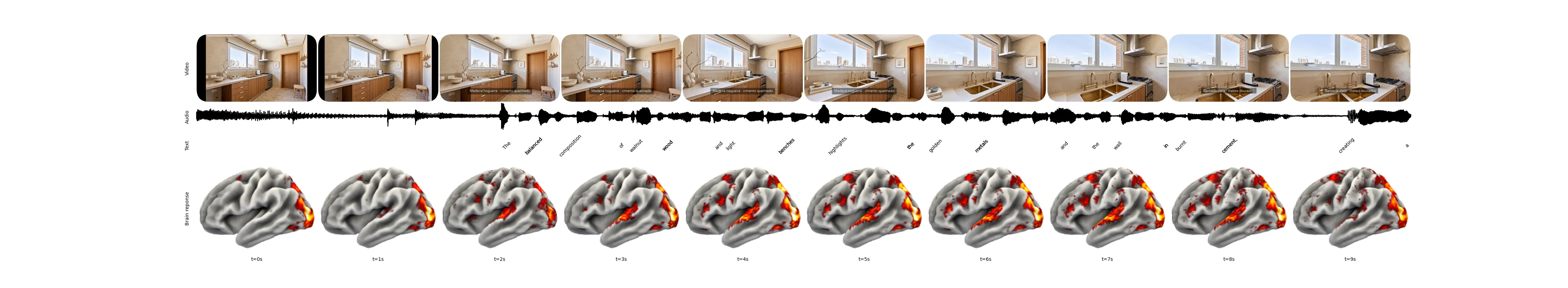

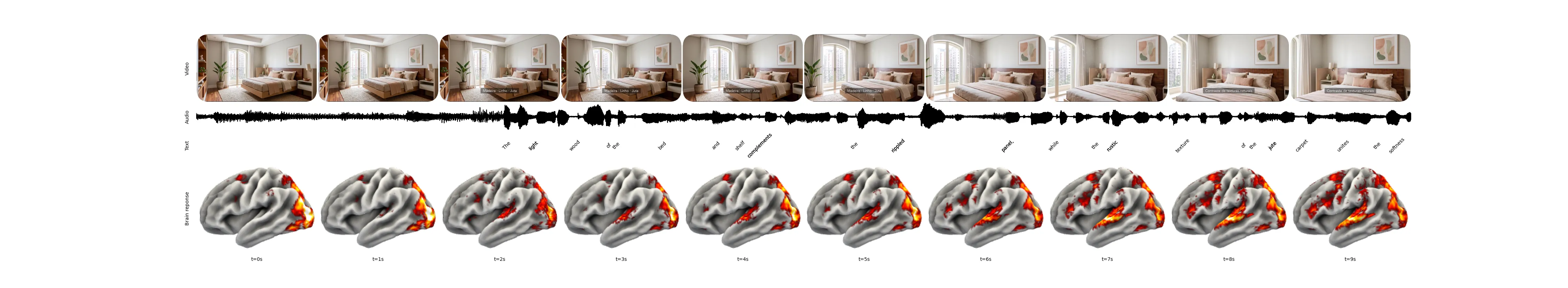

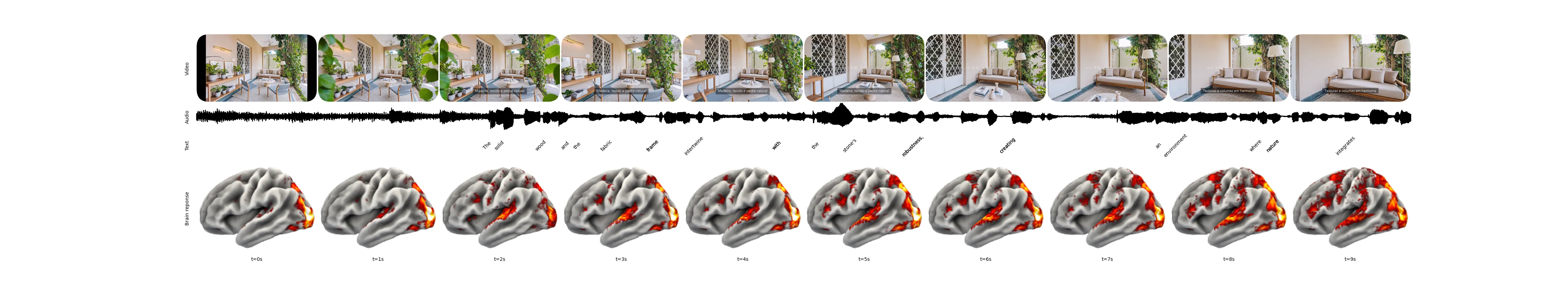

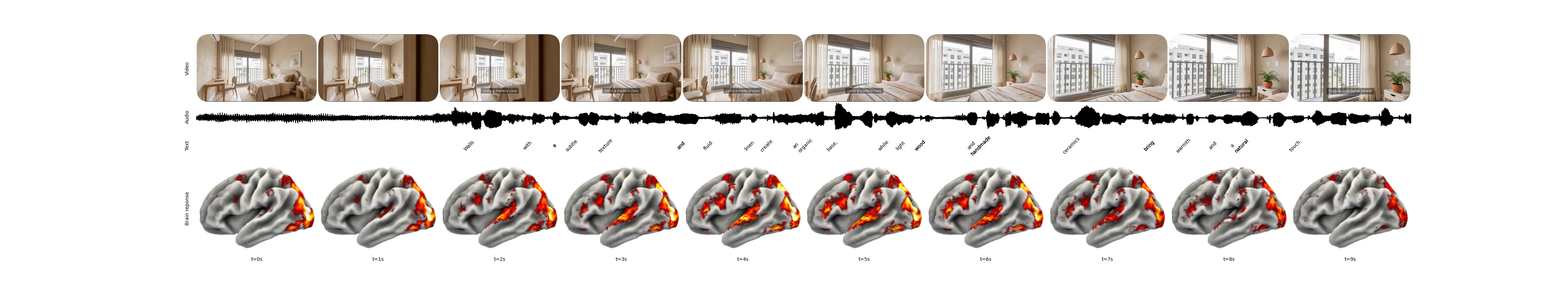

O que o cérebro vê em cada versão.

Ativação visual posterior. Áudio plano. Texto vazio. Padrão estável.

Ativação visual + córtex temporal lateral bilateral. Narração transcrita pelo modelo. Ramp-up dose-response sincronizado à fala.

Rotacione o cérebro. Arraste a linha do tempo.

Mesma predição do TRIBE V2 que produziu o heatmap anterior — agora navegável segundo a segundo, dos 24 segundos do vídeo do Ambient 7 · Cozinha.

Pré-computado via API do Space beta3/TRIBE_V2_Neural_Activity_Predictor · renderizado localmente com Plotly + fsaverage5 (20.484 vértices corticais).

Quatro redes corticais. Quatro modalidades.

Mesmo padrão. Cenas diferentes. Narrações diferentes.

Em todos: ativação posterior visual + córtex temporal lateral bilateral em B. Ramp-up dose-response sincronizado à narração.

Em nenhum dos dez ambientes o efeito previsto pela hipótese deixou de aparecer.

Cenas estruturalmente distintas — cozinhas, quartos, salas, terraços, corredores — produziram a mesma assinatura neural ao passar pela experiência integrada.

O TRIBE V2 leu nossa narração — palavra por palavra.

Quando a Versão B é processada, o próprio modelo da Meta transcreve a fala em sua linha de saída Text.

É demonstração direta de que o canal linguístico foi processado — não apenas registrado.

“A composição equilibrada de madeira nogueira e bancadas claras ressalta os metais dourados e a parede em cimento queimado.”Narração · ambient 7 · transcrita pelo TRIBE

A experiência integrada do Arquiteto de Bolso produz, segundo o TRIBE V2 da Meta, padrões de ativação em redes corticais auditivas e linguísticas que a apresentação visual sem narrativa não produz com a mesma robustez.

A localização anatômica do efeito (córtex temporal lateral) e sua dinâmica temporal (ramp-up sincronizado à narração) são coerentes com as modalidades adicionadas — não com diferenças visuais entre as cenas.

O que ainda queremos provar.

| Próximo passo | O que isola |

|---|---|

| Versão C — decorado silente | Separa a contribuição da decoração visual da contribuição da narrativa multimodal |

| Múltiplas seeds Veo | Estabelece envelope de ruído do modelo para inferência estatística |

| ROIs pré-definidas | Substitui interpretação visual por extração quantitativa de sinal por região cortical |

| Validação comportamental | Fecha o ciclo: ratings humanos correlacionados com magnitude TRIBE |

Não vendemos certeza. Vendemos evidência crescente — e o compromisso de continuar testando.

Decoração que conversa

com o cérebro.

Quando o ambiente é projetado para mais que os olhos, o cérebro responde de outra forma. A neurociência começa a confirmar.

Estudo TRIBE V2·10 ambientes·2026